Adobe Character Animator CC 2020 V3.1 WIIN & MAC — Adobe动感人脸追踪识别

Adobe新推出的Character Animator正式版,是一款角色动画软件,搭配Photoshop和Illustrator,可以帮助设计师实现人物动态化,在直播或录制动画中使用都非常方便。

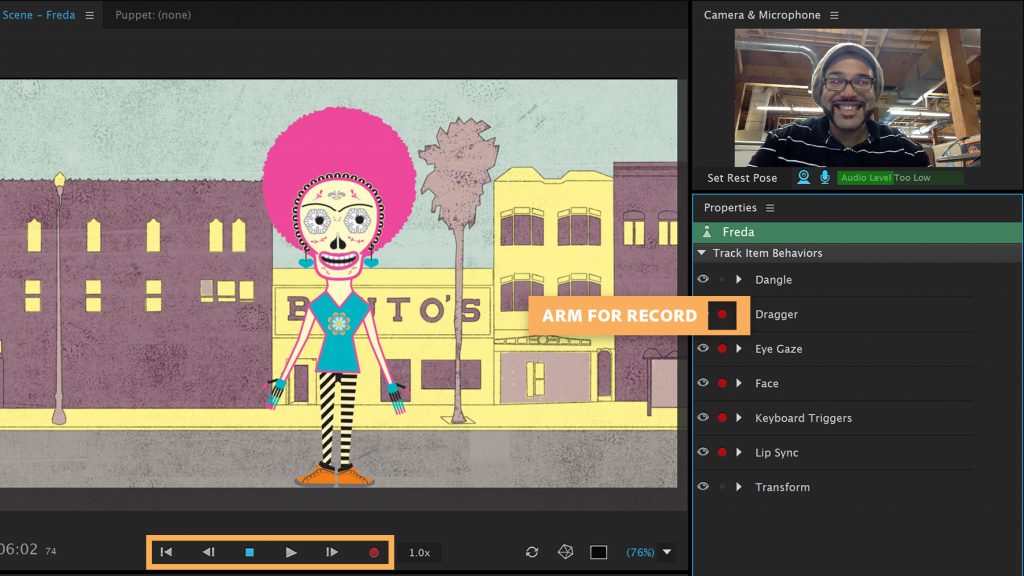

Adobe高级解决方案顾问Jeff Chan,带你快速上手这款软件的应用,教你如何通过工具内的人脸追踪技术,让系统自带或绘制出的矢量人物动起来。

视频体验

功能介绍

Character Animator 是一款直观的2d 角色动画应用程序,整体的界面风格,布局和Premiere 类似。

主要功能也像它的启动页上所展示的画面一样,强调的是“人偶和模仿”,和同厂的ae相比较,Character 的学习门槛较低,其核心的实时面部追踪绑定和语音识别是它的一大亮点所在。

作为adobe全家桶的一份子,我们可以在Photoshop或者illustrator中创建角色形象,并导入 Character 中的操控面板,再进行部件绑定。

然后通过录制演示动作,或者使用摄像头捕捉,麦克风记录等形式来直观的创造角色的动画。

使用者所输出的动画效果是否优秀,本质上取决于戏精你的“表演”是否生动,动作素材是否完整。

在初次打开软件时,Character 内置了一些人偶模版帮助我们快速上手学习如何创建动画,这些模版都提供了PhotoShop和illustroator 两种格式的源文件可以选择。

快速双击这些模版就可以打开源文件,这里我打开了“艾普史密斯医生”的Photoshop的源文件,在PS中,我们可以看到模版文件中对图层做出了详细的命名规范(注意:目前的Character只能识别以英文命名的图层)。

“艾普史密斯医生” 大致分为了“头部”和“身体”“背景”三部分,每一个部件都有单独的图层命名对应,如果这个部件有多个图层替换使用,例如“眼睛包含了眨眼,睁眼两种可识别的状态” 则需要在图层名前加上“ ” 号用于行为识别。

刚开始学习时,可以先仔细查阅源文件,明白命名的规范,记得对每一个部件进行编组操作,目前Character中的可识别行为属性只能赋予 “组”。

将整理好的文件导入面板中,Character能自动的读取文件命名,进行部件识别,并绑定行为。

当识别了具有行为属性的图层时,Character图层面板中会有皇冠图标标示,然后我们可以录制并细调一些动画的曲线等属性,控制面板和ae大同小异;时间轴面板和c4d 的关键帧记录功能相似。

成功绑定后,在录制面板开启摄像头和麦克风,就可以戏精的开始表演了。最后录制好的文件可以导出图片序列或者视频文件,当然你也可以使用它进行在线直播。

现在的Character已经具备一定生产力,但是限制还比较多,期待未来能看到它越来越完善。

评论留言